为什么2016美国大选大数据预测普遍失灵

摘要: 这是目前为止,史上最为科技化、数字化的一届选举。2016年这场美国总统竞选被媒体称作“第一次数字化竞选”,特别是希拉里组建了庞大的技术团队,将大量资金花在获取和使用投票者的信息上。在这场沸沸扬扬的、比《纸 ...

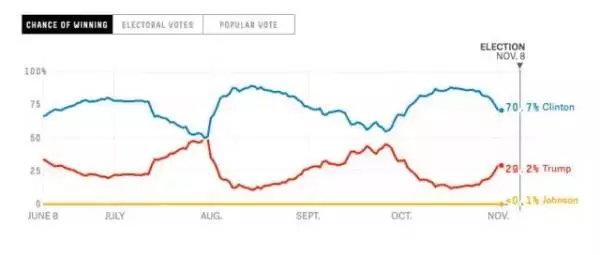

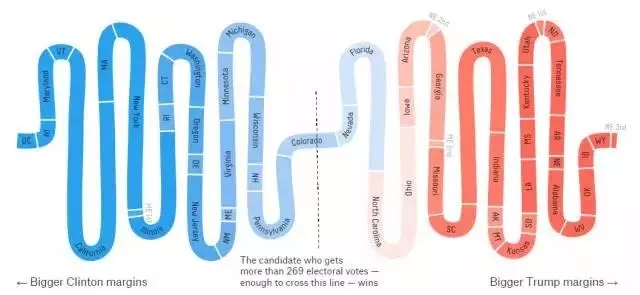

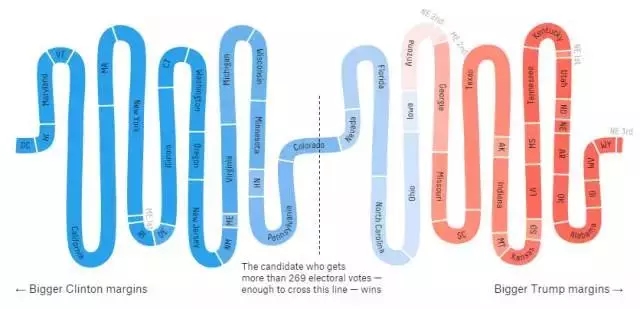

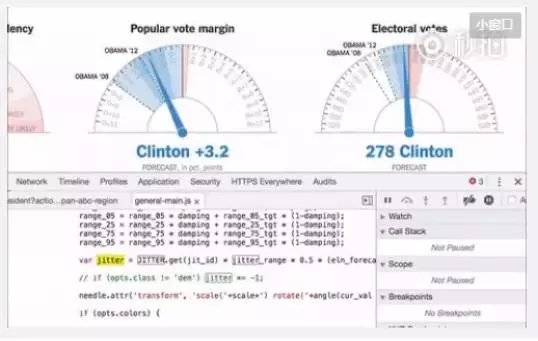

| 引言 这是目前为止,史上最为科技化、数字化的一届选举。 2016年这场美国总统竞选被媒体称作“第一次数字化竞选”,特别是希拉里组建了庞大的技术团队,将大量资金花在获取和使用投票者的信息上。 在这场沸沸扬扬的、比《纸牌屋》更引人入胜的政治宫廷大戏的事件中,我们不难看到许多频繁出现的关键词:大数据、社交网络、软件机器人、邮件、黑客,甚至维基解密爆料。 今天的候选人们已经意识到,以互联网为基础的信息技术可以在政治角逐中起到决定性的作用。人们将自己的信息放在网上,让各种网站记录自己的个人和财产信息,在社交网络上公开发表观点。这些公开的信息可以用来描绘出特定用户的面貌,其准确程度远远超过人口普查的结果。在这些数据中,蕴藏着商业、经济和政治的新机会。 大数据基因浓厚的选举 希拉里真正可怕的选举机器——一支来自于硅谷的 “科技天才们” 组成的超级团队。他们确实为希拉里的竞选立下了赫赫战功。 在小布什之前,互联网对于总统竞选团队来说还只是一个 ATM 机——他们不知道互联网除了做一个系统来让选民填写支票,提交捐款之外还有什么别的作用。这次大选,为希拉里选举服务的科技团队拥有 50 余人,相当于一家小有规模的硅谷科技创业公司。他们开发的核心产品就是希拉里·克林顿本人。这支科技团队至今给希拉里带来了 2.4 亿美元的募资额。  50多人科技团队出身硅谷,希拉里·克林顿的竞选有着浓厚的“硅谷风” 这支超级科技团队拆为三块:技术开发部(Techonology)、数字媒体部(Digital)、数据分析部(Analytics)。 数字媒体部负责所有竞选相关的内容:网站、社交媒体、线上广告、电邮、宣传视频、基层筹款与线上活动组织,更加偏向营销职能。 数据分析部负责收集和分析竞选中的数据,以实时监测和准确预测民意动向,精准投放募资和竞选广告,尤其是争取“摇摆州”的选民。 人员最多、最受媒体追捧的,是技术开发部。他们的主要职责是为希拉里开发竞选所需的所有形态的互联网产品。 核心成员清一色来自互联网大公司:有 4 人曾任 Google 高级工程师,其余的来自 Facebook、IBM、Adobe以及 A/B 测试公司 Optimizely、一线数据公司如 Bluelab、Blue State Digital。 在这支团队里,最值得一提的是副 CTO、前端开发负责人:卡尔·拉什(Kyle Rush)。他是 A/B 测试的专家,也是美国权威 A/B 测试公司 Optimizely 的负责人。他接受 7 位前端工程师和 6 个产品经理汇报,完成了大部分产品的优化。  卡尔·拉什作为专家参加 Velocity论坛,发表关于“更快更强的网络”的演讲 团队在成立后的近两年时间里,开发了大约 50 项后端框架,服务于 20 个前端应用。建立了 237 个 Github 项目,维护了一个为数据科学家和分析师团队服务的密集型数据仓库(大小为 15 TB)。产品矩阵包括一个希拉里竞选 APP,一个希拉里竞选主页(美国竞选史上最完备的网站与第一个 APP),和一个在危机中四小时建立的希拉里竞选邮箱系统。 如何进行大数据预测 希拉里挟名流、主流媒体和大数据的威势,在大选中似乎一直占据上风。但实际竞选结果与此前无数民调机构的调查结果都大相径庭。就连两次成功预测大选结果的538网站的Nate Silver预测大神也失算了。 Nate Silver被称为预测大神,是因为他对2008年和2012年美国大选的成功预测。2007年,Silver建立了“538”博客(后改为fivethirtyeight.com,因美国大选有538张选举人票),独树一帜地靠数据分析进行时政预测。2008年大选,Silver预测对了50个州选举结果中的49个。2012年,他预测奥巴马胜出概率高达9成,和一般专家说的奥巴马与罗姆尼五五开的预测很不同,最后结果出来全部50个州都预测对了。 2016年美国大选,Nate Silver又在538网站上不断更新对大选的预测。那么大数据到底是如何精准预测美国大选的? 数据来源 首先,Nate Silver进行预测并不是靠所谓的“直觉”,而是纯粹地靠数据,对众多的数据用算法进行处理。所以他做的是一个预测算法,编程实现的,报告的是计算结果,是“胜率80.7%”这种精确的数值,不是“希拉里优势明显”这种模糊的话。 在美国大选这个事件上,算法依靠的主要基础数据就是各种各样的“poll”,即大选民意调查。美国大选历时数月之久,全国以及每个州都有各种机构主办的不同规模的大选民意调查,一个州对一次大选可能有多达上百次的民调。如对佛罗里达州,538网站共收集了68次民调数据。(佛罗里达州的68个民调的详细数据在:http://projects.fivethirtyeight. ... n-foreCAst/florida/) 这就是Silver需要的“信号”。但是由于各种民调的机构背景、立场倾向、覆盖人群、举办时间差异极大,参考意义肯定各有不同,如何处理就是真正的技术了。这相当于要从一堆“信号”中,排除掉“噪声”,得到真正有效的信息。 基础技术 Nate Silver依靠的基础技术叫“贝叶斯理论”,是关于概率的理论。这听上去有些高深,特别是写成概率论里的P(A|B)这样的数学形式时,容易让人“不明觉厉”。其实并不难解释,原理很简单。 在没有任何信息时,可以认为希拉里和特朗普的胜率各为50%。这时出了一个州的民调,说问了1000个人,支持希拉里的有600人,投特朗普的有350人,还有50人两人都不喜欢,会投给独立参选人约翰逊。这么点人,应该决定不了最终的结果,但是据此上调希拉里的获胜概率,如调到50.1%,似乎有点道理。 如果全美有几千个这样的民调,全部考虑进来,有的让希拉里胜率增加,有的会提升特朗普的胜率,最后综合下来,就会有一个最终的胜率报告出来。 Nate Silver的分析方法好处是,随着最终大选的时间点临近,他的有效数据信息越来越多,算法预测会越来越准,最终和大选真实结果差不多了。如2012年对50个州的结果全部预测正确。而一般专家很难充分利用有效信息,多少会凭感觉去蒙,不会这么准确。 Nate Silver的方法揭示了一个深刻的道理,预测并不是一下子的事,而是一个概率序列,是需要不断收集信息更新认识的。一开始预测粗略或者改变倾向都是正常的,只要最终收敛向真实结果,这种方法就是科学的。只要细心收集数据、处理数据,这种方法是可以重复的。 当然,对于每一个民调数据,如何影响计算出来的概率,这是需要仔细考虑的,是预测算法真正的细节。这些民调差异极大,有时甚至给出完全相反的结果,如何解读确实不容易。538网站进行了细致的解释,如根据过去12次大选的历史记录,对发布民调机构的权威性进行分级,计算时分配不同的权重。针对民调覆盖的人群进行调整,如西裔会更倾向希拉里一些,不能代表全国的情况,要相应下调。 除了民调数据,经济数据也可能被考虑进来,因为经济数据好,会对在任党派有利,是重要影响因素。 这样的调整非常多,需要精心的数据观察,也需要对美国大选的具体过程很了解,是非常专业的。这也是可以不断改进的,538网站从2008年到2016年三次大选,都有一些小调整,2012年就加进了几个调整项。 由于各种民调的机构背景、立场倾向、覆盖人群、举办时间都有差异。所以Silver会根据拟投票选民、会后弹升、忽略第三党候选人、趋势走向、党派倾向五个因素对数据进行调整。 Nate Silver将概率学中的贝叶斯决策理论应用到大选预测中,用数学方法对未知事件进行概率分析。最后一步就是对所有不准确性作出解释,并对最终大选反复模拟测试,调整误差。随着大选日接近,不准确性会愈发降低。538给出了希拉里与川普各自的胜选可能性以及在几个月内的变化趋势。  Nate Silver可以解释清楚每天预测的胜率是怎么来的,公开给出复杂而精确的算法,对时政预测领域这是革命性的思想变革。 Nate Silver实际给出了几种算法,虽然不同算法的区别并不太大。如有一种算法考虑了经济数据,另一种不考虑,最终二者算出的数值会在大选前夜重合。 我们甚至发现,Nate Silver预测过程中的概率波动,与谷歌围棋程序AlphaGo和李世石对弈过程中的胜率曲线很类似!AlphaGo在对弈过程中也是每一步都不断更新双方胜率,高低起伏。但到棋局定型的时候,就会给出80%之类的高胜率,实际上胜负已定。 不确定的数据 值得注意的是,Nate Silver的预测方法非常依靠数据。所以,与其说他是“预测大神”,不如说他是“数据大神”。美国大选可以搞这种精确的胜率计算,因为各种媒体与机构报告了海量的民调数据。 可以肯定地说,没有一个民调是完全靠谱的,都会有偏差,有意或者无意。但是几千个民调提供的原始数据是很有意义的,因为可以对这些数据进行建模,无论误差是有意还是无意,都可以根据数据背景以及历史表现,进行有道理的调整。具体的调整方法太复杂,一般人不用去研究,但不难认识到这种方法的先进性。 如果没有足够的有效数据,那么Nate Silver就不能进行精准预测了,从他的方法来看会如此。这时某些直觉良好的专家可能就有用武之地了,这也是可以想象的。也许专家通过梳理逻辑,抓住了事情的关键,给出了方向性的预测并最终成功。这种情况肯定还会有,依靠数据预测并不能包打天下。 但是在数据足够的情况下,需要对Nate Silver引入的这种方法足够重视。从方法论来说,对数据进行越来越精确的建模,将各种因素尽可能多地考虑进来,是更科学更先进的。 但是,Silver自己解释了,他计算出来的是一个概率,并不是一个肯定的事。希拉里10月1日以67.3%领先特朗普的32.7%,这并非排除了特朗普的胜利可能。实际上算法会进行20000次模拟,其中有6000多次是特朗普获胜。因为离大选还有一定时间,会有不确定性,会带来“误差”。 主要有三种不确定性。一种是全国性的波动,会对每个州的数据都产生影响,如选举人丑闻爆出,所有州的数据都下调。一种是特定人群或者特定区域的州会受影响,如希拉里对中部地区人群出言不慎。一种是单一的一个州的波动。 |

雷达卡

雷达卡

提升卡

提升卡 置顶卡

置顶卡 沉默卡

沉默卡 变色卡

变色卡 抢沙发

抢沙发 千斤顶

千斤顶 显身卡

显身卡

京公网安备 11010802022788号

京公网安备 11010802022788号