你有没有想过这样一个问题:当 AI 参与代码编写时,比如优化一个推荐系统算法,它通常会怎么做?

大多数情况下,AI 会基于已有知识和模式,直接输出一个看似合理的解决方案。这种方式虽然快捷,但本质上依赖的是静态经验,往往只能提供一个中等水平的“60 分答案”,难以触及真正最优的解。

这就像让一个人设计一个承重结构,他大概率会画出横平竖直、规整对称的框架;而如果我们观察自然界中的类似结构——比如鸟类的骨骼或树木的根系——它们形态扭曲、看似杂乱无章,却在长期演化中形成了极高的稳定性和效率。

人类依赖的是线性思维和直观判断,而自然界的精妙结构则是亿万年试错、变异与淘汰后的演化成果。这种差异提示我们:真正的最优解,可能藏在不断迭代的过程中,而非一次性构思里。

那么,如果有一种 AI,能够模仿自然演化的机制,通过持续尝试、自我修正来寻找更优方案,会发生什么?

最近我测试了百度智能云推出的一款新产品——

伐谋

它并不是传统意义上的 AI 编程助手,而是全球首个可商用的自我演化超级智能体。你只需告诉它目标是什么(例如“让程序运行更快”),它就会自动进行多轮实验、调整逻辑、优化参数,像生物进化一样逐步“演化”出超越人类直觉的解决方案。

下面我用两个实际案例来展示它的能力。

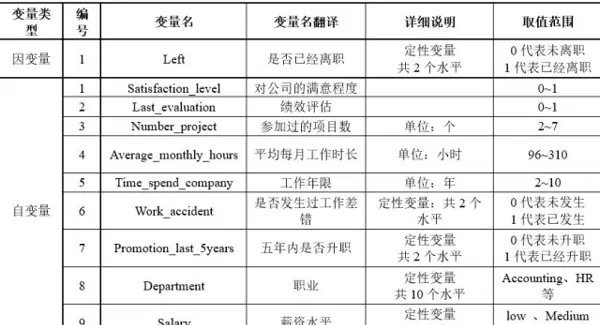

案例一:员工离职预测模型优化

第一个任务来自 Kaggle 的经典题目:利用员工历史数据(如年龄、薪资、工作年限等)构建模型,预测哪些员工有较高的离职风险。

我先让当前热门的 Gemini3 模型生成了一版初始代码,并将其导入到“伐谋”平台中。评估标准采用与 Kaggle 官方一致的评分机制——预测越准确,得分越高。

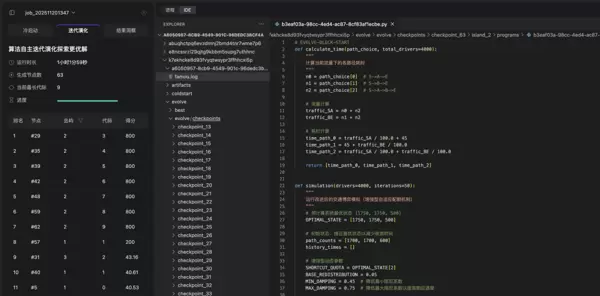

初始状态下,Gemini3 生成的代码得分为 0.49。随后,“伐谋”启动自我演化流程,经过多轮迭代,不断调整特征工程、重构模型逻辑、优化超参数,最终将预测准确率提升至 0.61,实现了显著突破。

尽管这个任务本质仍是寻找数据规律,属于线性推理范畴,但它已初步验证了“伐谋”在自动化优化方面的能力。

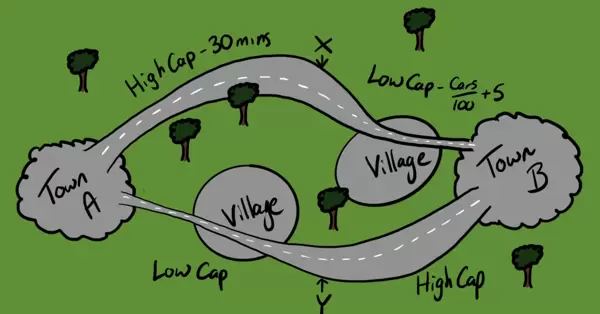

案例二:破解布雷斯悖论的交通调度挑战

为了进一步考验它的极限,我设置了一个更具迷惑性的非线性难题——布雷斯悖论(Braess's Paradox)。

场景设定如下:

假设你是某城市的交通指挥官,需要引导 4000 辆车从起点 A 到终点 B。原本有两条通行路线,每条的行驶时间随车流量增加而上升。市政部门为缓解拥堵,新增一条“超级快速路”,理论通行时间为接近零。

现在请你写一段 Python 代码,合理分配车辆路径,目标是使全城平均通勤时间最短(即评分最高)。

听起来很简单?既然有了更快的路,当然是让更多车走这条路才对吧?

我最初也让 Gemini 生成了一份代码,其策略非常符合直觉:优先使用最快路径,典型的贪婪算法。

# 典型的“贪婪算法” ?if?path_time < min_time:move_drivers()?# 哪里快就往哪里挤结果却是灾难性的——所有车辆涌入快速路,导致两端接口严重拥堵,整体通行效率暴跌,最终评分仅有 40 分。

这正是布雷斯悖论的核心所在:当每个个体都选择看似最优的路径时,反而会导致全局性能恶化。修了新路,却让大家更堵了。

我把这份失败的初始代码交给“伐谋”,开启自我演化后便不再干预,任其自主探索。

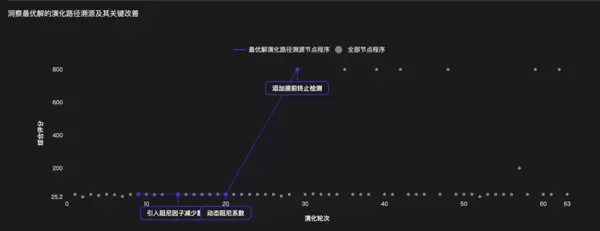

几十分钟后回来查看日志,整个演化过程清晰地分为三个阶段:

- 试错期: 系统发现全量走快速路会导致崩溃,开始随机分流尝试,评分缓慢上升。

- 突变期: 某个“种群”突然出现反常识策略,评分大幅跃升。

- 收敛期: 在高分策略基础上精细化调参、引入新函数,系统趋于稳定,评分持续攀升。

在这个过程中,“伐谋”不仅识别出了陷阱,还自主发明了两种关键机制:

1. 配额机制

它意识到“超级快速路”实为诱饵。一旦该路径车辆超过 500 辆,便立即停止自由分配,转而强制引导部分车辆回归原有路线,主动放弃局部优势以换取全局最优。

2. 阻尼机制

传统调度容易产生“钟摆效应”:A 路快 → 全去 A → A 堵 → 全去 B → B 又堵……循环震荡。

而“伐谋”演化出的代码引入了物理学中的“阻尼振动”思想:初期阻尼系数较小(0.45),允许较大波动以快速探索方向;后期阻尼增大(0.75),抑制震荡,锁定最优状态。

这套逻辑之严密,令人惊叹。

最终结果是,评分从最初的 40 分一路飙升至 800 分,实现了二十倍的增长。

我仔细查看了最终生成的代码,震惊的是:在没有任何人为提示的情况下,它竟然自行发现了并应用了物理学中的阻尼原理来稳定系统动态。

这已经不再是简单的代码生成,而是在

创造算法

在多个复杂的工程优化场景中,我也进行了测试,包括社交网络中的侮辱性言论识别、金融风控系统等实际应用。结果发现,问题越复杂、越违背直觉,这种具备自我推演与演化能力的智能体(Agent)表现就越突出,甚至远超预期。

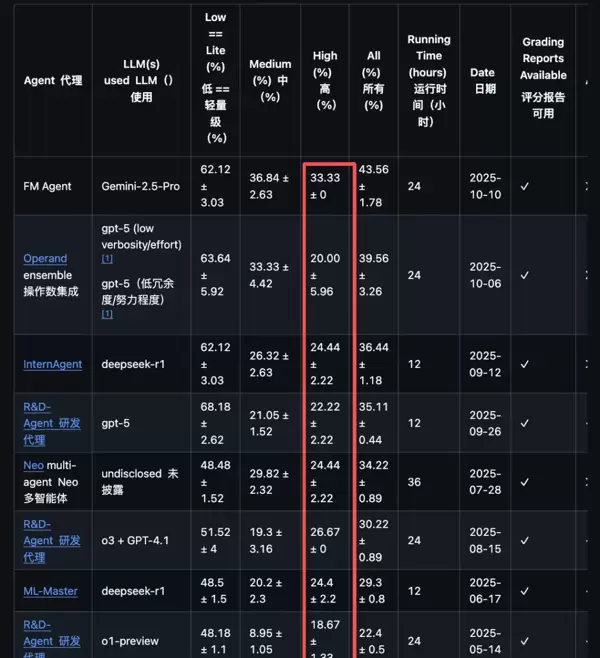

接下来我们来看它在相关基准测试中的具体表现,整体成绩非常亮眼。

在 MLE-Bench(机器学习工程基准)榜单上,前列长期被微软、DeepSeek 等大厂的 Agent 占据,竞争激烈。而“伐谋”在此榜单中成功登顶,达到 SOTA 水平,Any Medal 率高达 43.56%,领先第二名整整 4 个百分点。

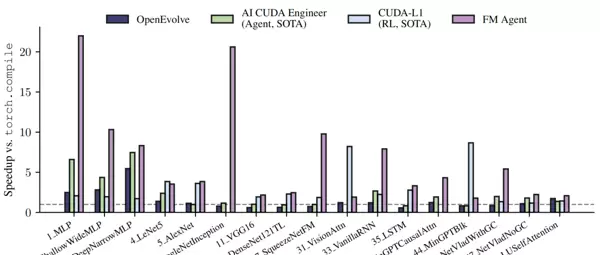

在 KernelBench 基准测试中,其表现更是遥遥领先。该基准用于评估 AI 自动生成高效 GPU(CUDA)内核代码的能力。结果显示,“伐谋”生成的代码相比 PyTorch 2.0 的核心编译器 torch.compile,在运行速度上实现了 2.08 倍至 20.77 倍的显著提升。

这一成果意义重大——因为 CUDA 代码的优化直接影响模型训练和推理的硬件成本。在当前显卡价格高昂的背景下,这类优化等同于直接降低成本。原本需要 20 天完成的训练任务,使用优化后的代码可能仅需 1 天即可完成。

深入研究其技术报告后可以发现,其底层机制融合了 LLM 推理与大规模进化搜索,逻辑设计与产品架构高度一致。

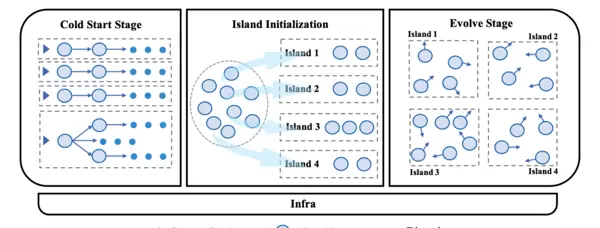

整个演化过程始于冷启动阶段。“伐谋”采用了聪明的初始化策略:允许注入人类专家编写的经验代码,或借助 LLM 生成高质量的初始种群,从而提高起点效率。

随后引入“岛屿模型”来避免算法陷入局部最优和“近亲繁殖”问题。系统在云端构建多个并行的“演化岛屿”,每个岛屿独立运行不同的演化策略:

例如,1 号岛可能专注于激进探索新解法,而 2 号岛则偏向保守稳健的迭代路径。各岛屿独立进化,互不干扰。但系统会周期性开启“基因迁移”通道,将 A 岛的优秀个体迁移到 B 岛,实现跨岛交流。这种“生态隔离 + 基因流动”的设计,极大提升了找到全局最优解的概率。

自然界的进化耗时以千万年计,但我们无法等待那么久。“伐谋”基于高性能分布式框架 Ray 构建,如同一台时间压缩机,能够将成千上万个方案的生成、评估与淘汰任务,并行分发到大规模计算集群中执行。

人类工程师可能需要数月才能完成的试错过程,它可以在几小时内完成数千代演化,效率不可同日而语。

经过一段时间的实际体验,我发现“伐谋”虽然有一定上手门槛,但它是我目前见过的第一个真正具备自我进化能力的 AI 工具。

回顾过去几年,AI 多数扮演的是 Copilot(副驾驶)角色:你写代码,它补全;你提需求,它出方案。在这种模式下,AI 的上限受限于人类的想象力和表达能力——如果你想不到更好的方法,AI 也无法突破。

但“伐谋”所采用的自我演化范式,正在打破这一瓶颈。它不再简单模仿人类思维,而是模拟自然进化的机制,让创新方案自发涌现。

比如,人类工程师或许多年都难以想到用阻尼机制解决交通分配问题,但在“伐谋”的演化引擎中,这类反直觉却高效的策略会自然产生。

这意味着,工程师的角色正从传统的“手艺人”转变为“驯化者”。

就像一万年前人类驯化狼,逐渐培育出适应不同环境的狗一样。你不需要指导它如何长出厚毛抵御严寒,只要设定生存规则,自然选择就会保留最适应的个体。

“伐谋”将这个漫长的自然选择过程压缩到了几小时之内。你无需告诉 AI 如何优化一段 CUDA 代码,只需设定目标:“算得越快越好”,然后交由系统自行演化数千代。

最终输出的方案,可能是人类工程师耗费数月反复调试才能得到的结果。

这并不是取代人类工程师,而是解放他们。把那些重复、枯燥、高密度的参数调优工作,交给云端持续运转的演化引擎;而人类则可以把精力集中在更高价值的任务上:定义问题边界、设计评估体系、做出战略决策。

同时,这种能力也为应对更复杂的工业化挑战提供了可能。

当然,“伐谋”目前并非完美无缺。它的演化过程依赖大量算力支持,且需要一定时间收敛,并不能解决所有类型的问题。但从方向上看,这是正确的路径。

面对复杂优化问题,未来的 AI 或许不再需要依赖人类经验的传授,而是通过自主演化,发现人类从未设想过的解决方案——正如 AlphaGo 曾下出令人惊叹的“上帝之手”。

因此,如果你的工作涉及工程优化、参数调优或算法迭代,我建议尽早尝试“伐谋”。它代表了一种全新的可能性:让 AI 不再是工具,而是共同进化的伙伴。

雷达卡

雷达卡

京公网安备 11010802022788号

京公网安备 11010802022788号