简介

如果你曾构建过这样的AI智能体——在笔记本中运行完美无缺,可一旦部署到生产环境就彻底崩溃,那么你并不孤单。API调用超时、大语言模型(LLM)返回格式错乱、限流在最关键的时刻触发,这些都是部署AI智能体时的常见痛点。

部署智能体的现实往往混乱不堪,而大部分麻烦都源于如何优雅地处理失败。但关键在于:你无需庞大的框架来解决这些问题。这5个Python装饰器曾帮我解决了无数头疼的问题,相信它们也能帮到你。

1. 带指数退避的自动重试装饰器

每个AI智能体都会与外部API交互,而所有外部API终究会出现故障。可能是OpenAI返回429状态码(触发限流),也可能是短暂的网络波动。无论哪种情况,你的智能体都不应该在第一次失败时就直接放弃。

@retry装饰器可以包裹任何函数,当函数抛出特定异常时,它会等待一段时间后重试。其中,指数退避(exponential backoff)至关重要——重试等待时间会随每次尝试递增:第一次重试等待1秒,第二次等待2秒,第三次等待4秒,以此类推。这样可以避免持续请求本就处于故障状态的API,减轻其负担。

你可以使用time.sleep()和循环自行编写简单的包装器,也可以直接使用Tenacity库——它提供了经过实战检验的@retry装饰器,开箱即用。关键是要配置正确的异常类型:对于有问题的提示词(每次都会失败),无需重试;但对于连接错误和限流响应,绝对需要重试。

示例(基于Tenacity库):

from tenacity import retry, stop_after_attempt, wait_exponential, retry_if_exception_type

import requests

# 配置:最多重试3次,等待时间1s、2s、4s

@retry(

stop=stop_after_attempt(3),

wait=wait_exponential(multiplier=1, min=1, max=10),

retry=retry_if_exception_type((requests.exceptions.Connection error, requests.exceptions.HTTPError))

)

def call_openai_api(prompt):

response = requests.post(

"https://api.openai.com/v1/chat/completions",

json={"model": "gpt-4", "messages": [{"role": "user", "content": prompt}]},

headers={"Authorization": "Bearer YOUR_API_KEY"}

)

response.raise_for_status() # 触发HTTP错误(如429)

return response.json()

# 调用函数,自动重试限流/连接错误

try:

result = call_openai_api("Explain Python decorators in simple terms.")

print(result)

except Exception as e:

print(f"Failed after retries: {e}")

2. 超时保护装饰器

LLM调用可能会挂起。这种情况不常发生,但一旦发生,你的智能体就会陷入停滞,用户只能盯着加载动画等待。更糟的是,如果你并行运行多个智能体,一个挂起的调用可能会成为整个流水线的瓶颈。

@timeout装饰器为函数运行设置了硬性上限。例如,如果函数在30秒内未返回,装饰器会抛出TimeoutError,你可以捕获该异常并优雅处理。对于同步代码,通常使用Python的signal模块实现;如果是异步场景,则使用asyncio.wait_for()。

将它与重试装饰器结合,会形成强大的组合:如果调用挂起,超时机制会终止它,然后重试逻辑会启动新的尝试。仅此一点,就能消除大部分生产环境中的故障。

示例(同步代码超时装饰器):

import signal

from functools import wraps

def timeout(seconds=30):

def decorator(func):

def _handle_timeout(signum, fr ame):

raise TimeoutError(f"Function {func.__name__} timed out after {seconds} seconds")

@wraps(func)

def wrapper(*args, **kwargs):

# 注册信号处理器

signal.signal(signal.SIGALRM, _handle_timeout)

signal.alarm(seconds) # 设置超时时间

try:

return func(*args, **kwargs)

finally:

signal.alarm(0) # 取消超时

return wrapper

return decorator

# 应用超时装饰器(限制10秒)

@timeout(seconds=10)

def call_llm(prompt):

# 模拟耗时的LLM调用

import time

time.sleep(15) # 超过超时时间,会触发TimeoutError

return "LLM response: " + prompt

try:

call_llm("Write a short story.")

except TimeoutError as e:

print(e) # 输出:Function call_llm timed out after 10 seconds

3. 响应缓存装饰器

这是一个能大幅降低API成本的技巧。如果你的智能体多次使用相同的参数调用同一个函数(这种情况很常见,尤其是在多步推理循环中),就没有必要为同一个响应支付两次费用。

@cache装饰器会根据函数的输入参数存储调用结果。下次函数使用相同参数被调用时,装饰器会立即返回存储的结果。Python内置的functools.lru_cache适用于简单场景,但对于智能体工作流,你需要支持生存时间(TTL)的缓存——让缓存的响应在合理的时间窗口后过期。

这一点比你想象的更重要。使用工具调用模式的智能体,常常会重新验证之前的结果或重新获取已经拿到的上下文。缓存这些调用不仅能加快执行速度,还能减少月末的API账单。

示例(带TTL的缓存装饰器):

from functools import wraps

import time

from typing import Dict, Tuple

def ttl_cache(ttl_seconds=3600):

cache: Dict[Tuple, Tuple[float, any]] = {} # 缓存格式:(参数) -> (时间戳, 结果)

def decorator(func):

@wraps(func)

def wrapper(*args, **kwargs):

# 将参数转为可哈希的元组,作为缓存键

key = (args, frozenset(kwargs.items()))

now = time.time()

# 检查缓存是否存在且未过期

if key in cache:

cache_time, result = cache[key]

if now - cache_time < ttl_seconds:

return result

# 执行函数并缓存结果

result = func(*args, **kwargs)

cache[key] = (now, result)

return result

return wrapper

return decorator

# 应用缓存(缓存1小时)

@ttl_cache(ttl_seconds=3600)

def get_weather(city):

# 模拟调用天气API(耗时且有成本)

import requests

response = requests.get(f"https://api.weatherapi.com/v1/current.json?key=YOUR_KEY&q={city}")

return response.json()

# 第一次调用:执行API请求并缓存

print(get_weather("London"))

# 1小时内再次调用:直接返回缓存结果,不发起API请求

print(get_weather("London"))

4. 输入输出验证装饰器

大语言模型本质上是不可预测的。你发送一个精心设计的、要求返回JSON的提示词,但有时得到的却是带有尾随逗号的Markdown代码块,导致解析失败。@validate装饰器会在边界处捕获这些问题,防止错误数据流入智能体的深层逻辑。

在输入侧,装饰器检查函数接收的参数是否符合预期的类型和约束;在输出侧,它验证返回值是否符合预设的模式——而Pydantic库能让这个过程变得极其简洁。你只需将预期的响应定义为Pydantic模型,装饰器就会尝试将LLM输出解析为该模型。如果验证失败,你可以重试调用、应用修复函数,或回退到默认值。

真正的优势在于:验证装饰器能将隐性的数据损坏转化为显性的、可捕获的错误。你可以在几分钟内调试完问题,而不是花费数小时。

示例(基于Pydantic的验证装饰器):

from functools import wraps

from pydantic import BaseModel, Validation error

# 定义LLM输出的预期模型

class LLMResponse(BaseModel):

answer: str

confidence: float # 0-1之间的置信度

sources: list[str] # 引用来源列表

def validate_output(model):

def decorator(func):

@wraps(func)

def wrapper(*args, **kwargs):

result = func(*args, **kwargs)

try:

# 尝试将结果解析为指定模型

return model(**result)

except Validation error as e:

print(f"Output validation failed: {e}")

# 验证失败时的处理:重试、修复或回退

raise # 此处简化为抛出异常,实际可替换为重试逻辑

return wrapper

return decorator

# 应用输出验证装饰器

@validate_output(LLMResponse)

def call_llm_for_answer(prompt):

# 模拟LLM返回(正常情况)

# return {"answer": "Python decorators are useful.", "confidence": 0.95, "sources": ["Python Docs"]}

# 模拟LLM返回格式错误(confidence为字符串,sources缺失)

return {"answer": "Python decorators are useful.", "confidence": "high"}

try:

response = call_llm_for_answer("What are Python decorators?")

print(response.answer)

except Validation error:

print("Failed to get valid LLM response.")

5. 回退链装饰器

生产环境中的智能体需要备用方案。如果主模型宕机、向量数据库无法访问、工具API返回无效数据,你的智能体应该优雅降级,而不是直接崩溃。

@fallback装饰器允许你定义一系列备选函数。装饰器首先尝试调用主函数,如果主函数抛出异常,则依次调用链中的下一个函数。你可以设置这样的回退逻辑:从GPT-5.4到Claude,再到本地的Llama模型;或者从实时数据库查询到缓存快照,再到硬编码的默认值。

实现方式很简单:装饰器接收一个备选可调用对象列表,在主函数失败时迭代调用它们。你还可以添加日志记录,跟踪每一次回退的层级,明确系统降级的原因和位置。这种模式在生产级机器学习系统中随处可见,将其封装为装饰器,可以让回退逻辑与业务代码分离,保持代码整洁。

示例(回退链装饰器):

from functools import wraps

import logging

logging.basicConfig(level=logging.INFO)

def fallback(*fallback_funcs):

def decorator(func):

@wraps(func)

def wrapper(*args, **kwargs):

# 先尝试主函数

try:

result = func(*args, **kwargs)

logging.info(f"Successfully executed primary function: {func.__name__}")

return result

except Exception as e:

logging.warning(f"Primary function {func.__name__} failed: {e}")

# 依次尝试备选函数

for fallback_func in fallback_funcs:

try:

result = fallback_func(*args, **kwargs)

logging.info(f"Fell back to {fallback_func.__name__}")

return result

except Exception as e:

logging.warning(f"Fallback function {fallback_func.__name__} failed: {e}")

# 所有函数都失败时抛出异常

raise Exception("All primary and fallback functions failed")

return wrapper

return decorator

# 定义主函数和备选函数

def call_gpt(prompt):

# 模拟主模型(GPT-5.4)失败

raise Exception("GPT-5.4 is down")

def call_claude(prompt):

# 模拟备选模型(Claude)正常运行

return f"Claude response to: {prompt}"

def call_llama(prompt):

# 模拟第二个备选模型(本地Llama)

return f"Llama response to: {prompt}"

# 应用回退装饰器:主函数call_gpt,备选函数call_claude、call_llama

@fallback(call_claude, call_llama)

def get_llm_response(prompt):

return call_gpt(prompt)

# 调用函数,会自动回退到第一个可用的备选函数

response = get_llm_response("Explain quantum computing simply.")

print(response)

结论

在构建可靠的AI智能体时,装饰器是Python中最被低估的特性之一。本文介绍的5种装饰器模式,解决了智能体离开Jupyter笔记本、进入生产环境后最常见的故障场景。

而且它们可以完美组合:将@retry、@timeout和@validate叠加使用,你就能得到一个不会挂起、不会轻易放弃、不会悄悄传递错误数据的函数。从今天开始,为你的API调用添加重试逻辑吧。一旦你感受到错误处理变得多么简洁,你会希望在所有地方都用上装饰器。

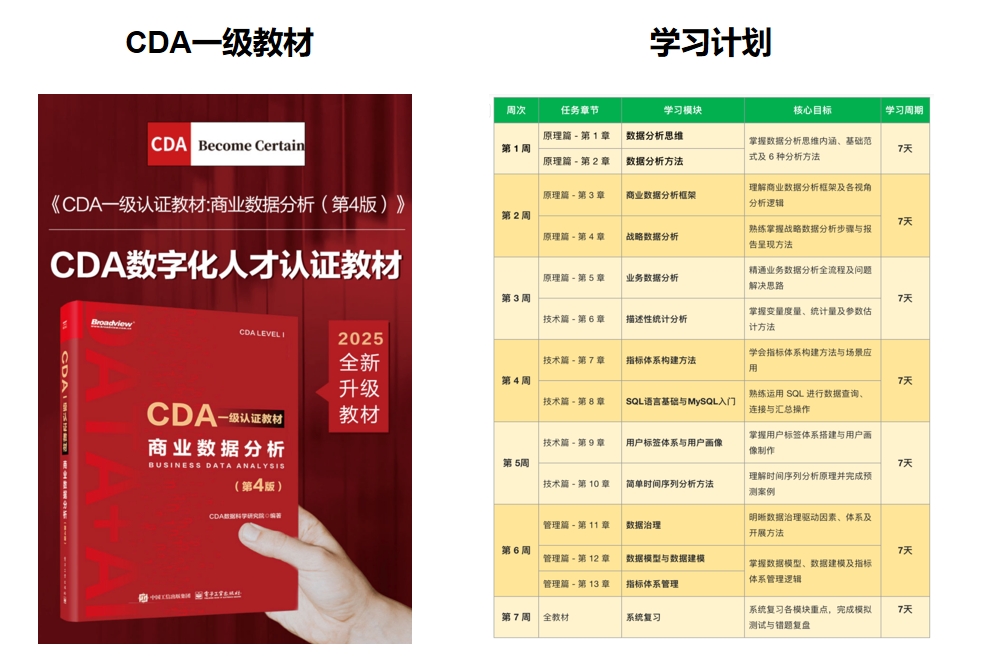

推荐学习书籍 《CDA一级教材》适合CDA一级考生备考,也适合业务及数据分析岗位的从业者提升自我。完整电子版已上线CDA网校,累计已有10万+在读~ !

雷达卡

雷达卡

京公网安备 11010802022788号

京公网安备 11010802022788号