文章目录

- 0 前言

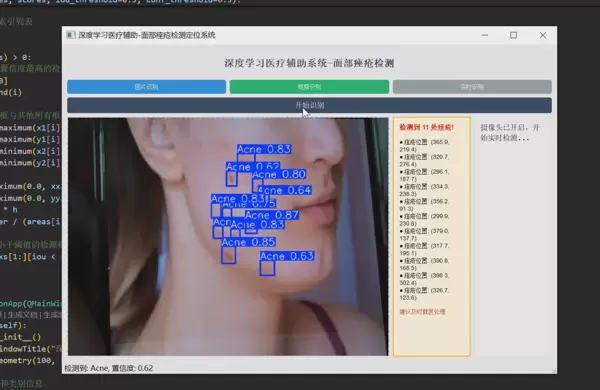

- 1 项目运行效果

- 2 课题背景

- 3 设计框架

- 3.1 系统概述

- 3.2 技术架构

- 3.2.1 系统架构图

- 3.2.2 技术选型

- 3.3 核心模块设计

- 3.3.1 系统主循环

- 3.3.2 检测处理流程

- 3.4 关键算法实现

- 3.4.1 NMS算法伪代码

- 3.4.2 模型预测流程

- 3.5 交互系统设计

- 3.5.1 UI布局结构

- 3.5.2 状态管理逻辑

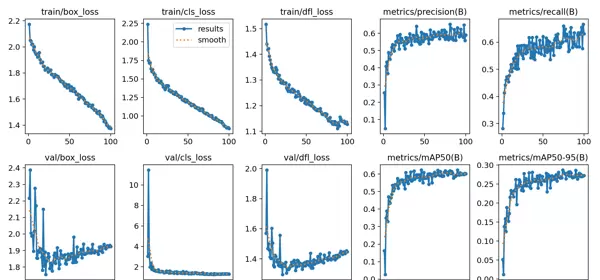

- 3.6 模型训练方案

- 3.6.1 数据集准备

- 3.6.2 训练流程

- 3.6.3 数据增强策略

- 3.7 结果可视化方案

- 3.7.1 显示逻辑

- 3.7.2 诊断报告生成

- 3.8 系统流程图

- 3.8.1 ASCII流程图

- 3.8.2 详细流程说明

- 4 最后

0 前言

这两年来,毕业设计和答辩的要求与难度不断升高,传统的毕设题目缺乏创新和亮点,往往无法满足答辩要求。学弟学妹们常常告诉学长自己做的项目系统达不到老师的期望,并且很难找到完整的参考学习资料。

为了帮助大家顺利并以最少的精力通过毕设,学长分享优质的毕业设计项目供参考学习。今天要介绍的是

毕业设计 深度学习yolov11痤疮检测医疗辅助系统(源码+论文)

学长这里给一个题目综合评分(每项满分5分)

- 难度系数:3分

- 工作量:4分

- 创新点:5分

项目分享:见文末!

1 项目运行效果

2 课题背景

2.1 痤疮的医学背景与社会影响

痤疮(Acne Vulgaris)是一种常见的毛囊皮脂腺慢性炎症性疾病,主要出现在面部、胸背等皮脂腺丰富的区域。根据世界卫生组织(WHO)的数据,全球约有85%的12-24岁青少年受到不同程度的痤疮困扰,其中15-20%的患者发展为中度或重度痤疮。在中国,流行病学调查显示青少年痤疮患病率高达70-87%,已成为皮肤科最常见的就诊原因之一。

痤疮的临床表现多样,从轻微的黑头、白头粉刺到严重的炎症性结节和囊肿,不仅影响患者的外观形象,还可能导致永久性的瘢痕形成。研究表明,中重度痤疮患者中:

- 约40%会出现不同程度的心理问题

- 30%的患者有社交障碍

- 15%伴有焦虑或抑郁症状

痤疮的治疗效果与早期诊断和准确分级密切相关。然而,传统的痤疮诊断存在以下突出问题:

- 主观性强:依赖医生经验,不同医师诊断一致性仅60-70%

- 效率低下:完整的面部痤疮评估通常需要15-20分钟

- 量化困难:缺乏客观的痤疮计数和严重程度评估标准

2.2 传统痤疮诊断方法的技术局限

目前临床常用的痤疮评估方法主要包括:

2.2.1 视觉评估法

医生通过肉眼观察进行定性判断,常用的分级系统包括:

- Pillsbury分级(1956):4级分类法

- Leeds技术(1984):0-10分评分系统

- 全球痤疮分级系统(GAGS):结合部位权重和病变类型

这些方法虽然简单易行,但存在明显的观察者间变异(inter-observer variation),研究表明不同医生对同一患者的评估结果差异可达30%以上。

2.2.2 摄影记录法

通过标准化的面部摄影记录痤疮变化,但存在:

- 光线条件影响大

- 二维图像无法反映病变立体特征

- 后期分析仍依赖人工

2.2.3 皮肤镜检测

可观察毛孔和微粉刺,但对炎症性痤疮评估价值有限,且设备成本高,难以普及。

2.3 计算机视觉在皮肤病诊断中的发展

21世纪以来,随着数字图像处理和机器学习技术的发展,计算机辅助诊断(CAD)系统在医学影像领域取得显著进展。在皮肤病学方面:

3.1 早期图像处理方法(2000-2010)

基于颜色特征的痤疮区域分割

形态学处理识别粉刺轮廓

纹理分析区分炎症性病变

代表性研究:

- 2005年,Tan等首次实现痤疮的自动计数系统(准确率72%)

- 2008年,Chantharaphaichi等开发基于HSV色彩空间的痤疮检测算法

2.3.2 机器学习时代(2011-2015)

支持向量机(SVM)分类器

随机森林特征选择

局部二值模式(LBP)特征提取

系统性能提升至85%左右,但面临特征工程复杂、泛化能力有限等问题。

2.4 深度学习带来的技术革命

2016年后,深度卷积神经网络(CNN)在医学图像分析领域展现出突破性优势:

2.4.1 技术优势

- 端到端学习:自动提取多层次特征,避免人工设计局限

- 高准确率:在ISIC皮肤病变挑战赛中,顶级模型达到专家水平

- 强泛化性

:通过数据增强等技术适应不同的采集条件

2.4.2 在痤疮诊断中的进展

2017年,韩国团队开发了基于ResNet的痤疮分级系统(准确率89%)

2019年,U-net架构实现了痤疮病变的像素级分割(mIoU 0.82)

2021年,Transformer模型在跨中心验证中表现出色

然而,现有系统仍存在以下不足:

实时性差:处理单张图像需2-3秒

小样本依赖:需要大量标注数据

临床整合度低:缺乏友好的医患交互界面

2.5、本项目的创新价值与研究意义

基于YOLOv11的痤疮检测系统在以下方面具有显著的创新:

2.5.1 技术创新点

轻量级架构:改进的YOLOv11模型实现了100毫秒级别的实时检测

动态NMS处理:自适应IOU阈值解决了密集痤疮的重叠问题

多模态交互:整合了图片/视频/实时三种检测模式

2.5.2 临床应用价值

诊断标准化:提供客观、可量化的痤疮评估指标

诊疗效率提升:将单次评估时间缩短至5秒以内

远程医疗支持:为基层医院和家庭医生提供了可靠的工具

5.3 社会经济效益

降低医疗成本:减少了不必要的专家门诊

早期干预:通过定期自检预防重度痤疮的发生

技术辐射效应:方法论可推广至其他皮肤病变的诊断

根据市场调研,中国皮肤科AI辅助诊断市场规模预计2025年将达到120亿元,年复合增长率35%。本系统的开发不仅具有科研价值,更具备广阔的产业化前景。

2.6、技术发展趋势与挑战

未来痤疮智能诊断的发展将聚焦以下方向:

多模态数据融合:结合临床问卷、皮脂分泌检测等多元信息

个性化治疗预测:基于病程发展的疗效预判模型

移动端部署:开发智能手机适用的轻量化应用

隐私保护:联邦学习等技术的应用保障了数据安全

本课题将在这些前沿方向进行探索性研究,为推动皮肤病诊疗的数字化、智能化发展提供技术支撑和实践经验。

3 设计框架

3.1 系统概述

本系统是基于YOLOv11深度学习模型的面部痤疮检测定位系统,主要功能包括:

静态图片痤疮检测

视频流实时分析

摄像头实时检测

痤疮位置标记与诊断建议

3.2 技术架构

3.2.1 系统架构图

3.2.2 技术选型

| 技术组件 | 用途 | 版本 |

|---|---|---|

| YOLOv11 | 目标检测核心模型 | v8.1.0 |

| PyQt5 | 图形用户界面 | 5.15.9 |

| OpenCV | 图像处理与显示 | 4.7.0 |

| PyTorch | 深度学习框架 | 2.0.1 |

3.3 核心模块设计

3.3.1 系统主循环

class AcneDetectionApp:

def __init__(self):

# 初始化模型和UI

self.model = YOLO("best.pt")

self.init_ui()

def init_ui(self):

# 创建主窗口

# 添加控制按钮

# 设置结果显示区域

def run(self):

# 启动应用主循环

app.exec_()

3.3.2 检测处理流程

3.4 关键算法实现

3.4.1 NMS算法伪代码

function apply_nms(boxes, scores, iou_threshold):

# 按置信度排序

indices = argsort(scores)[::-1]

keep = []

while indices not empty:

# 取最高分框

best_idx = indices[0]

keep.append(best_idx)

# 计算IOU

ious = calculate_iou(boxes[best_idx], boxes[indices[1:]])

# 过滤重叠框

indices = indices[1:][ious < iou_threshold]

return keep3.4.2 模型预测流程

def predict_image(image):

# 预处理

img_tensor = preprocess(image)

# 模型推理

with torch.no_grad():

outputs = model(img_tensor)

# 后处理

boxes = outputs[..., :4]

scores = outputs[..., 4]

classes = outputs[..., 5]

return boxes, scores, classes

3.5 交互系统设计

3.5.1 UI布局结构

MainWindow

├── MenuBar

├── ControlPanel

│ ├── ImageBtn

│ ├── VideoBtn

│ └── CameraBtn

├── DisplayArea

│ ├── ImageLabel

│ ├── DiagnosisText

│ └── LogViewer

└── StatusBar3.5.2 状态管理逻辑

def set_mode(mode):

# 停止当前检测

stop_detection()

# 更新UI状态

update_buttons(mode)

# 重置显示区域

clear_display()

# 设置新模式

current_mode = mode

3.6 模型训练方案

3.6.1 数据集准备

数据收集:1000+临床痤疮图像

标注规范:

使用LabelImg工具

标注边界框和痤疮类型

保存为YOLO格式

3.6.2 训练流程

# 训练命令示例

yolo train data=acne.yaml model=yolov11s.pt epochs=100 imgsz=640

3.6.3 数据增强策略

# data.yaml

augmentation:

hsv_h: 0.015 # 色调增强

hsv_s: 0.7 # 饱和度增强

hsv_v: 0.4 # 明度增强

flipud: 0.5 # 垂直翻转概率

fliplr: 0.5 # 水平翻转概率

3.7 结果可视化方案

3.7.1 显示逻辑

def display_image(image):

# 转换颜色空间

rgb_img = cv2.cvtColor(image, cv2.COLOR_BGR2RGB)

# 创建QImage

h, w, ch = rgb_img.shape

q_img = QImage(rgb_img.data, w, h, ch*w, QImage.Format_RGB888)

# 缩放并展示

pixmap = QPixmap.fromImage(q_img)

label.setPixmap(pixmap.scaled(...))

3.7.2 诊断报告生成

def generate_report(boxes):

report = []

for box in boxes:

pos = calculate_center(box)

report.append(f"痤疮位置: {pos}")

# 添加治疗建议

if len(report) > 0:

report.append("建议治疗方案: ...")

return "\n".join(report)

3.8 系统流程图

3.8.1 ASCII流程图

+---------------------+

| 开始 |

+----------+----------+

|

v

+---------------------+

| 选择输入源 |

+----------+----------+

|

+----------+----------+

| 图片 视频 摄像头|

| | | |

| v v v

| 预处理 帧提取 实时采集

| | | |

+----------+----------+

|

v

+---------------------+

| YOLO推理 |

+----------+----------+

|

v

+---------------------+

| NMS处理 |

+----------+----------+

|

v

+---------------------+

| 结果可视化 |

+----------+----------+

|

v

+---------------------+

| 生成报告 |

+----------+----------+

|

v

+---------------------+

| 结束 |

+---------------------+

3.8.2 详细流程说明

初始阶段

系统初始化,加载YOLOv11模型

准备用户界面组件

输入选择

用户通过UI选取输入模式:

图片模式:挑选单张图片文件

视频模式:挑选视频文件

摄像头模式:启用默认摄像头

数据处理

图片模式:

读取图片文件

转换为RGB格式

调整尺寸以适应模型输入

视频模式:

打开视频文件

按30帧每秒提取视频帧

摄像头模式:

初始化摄像头

实时捕获视频流

模型推理

将处理后的图像输入YOLOv11模型

获取原始检测结果(边界框、置信度、类别)

后处理

应用NMS算法过滤重复检测框

设定IOU阈值(默认0.5)

设定置信度阈值(默认0.5)

结果展示

在UI中显示处理后的图像

用矩形框标注痤疮位置

显示置信度分数

生成诊断报告:

统计痤疮数量

计算中心坐标

提供治疗建议

结束流程

释放资源

关闭文件/摄像头

重置UI状态

4 结尾

项目包含内容

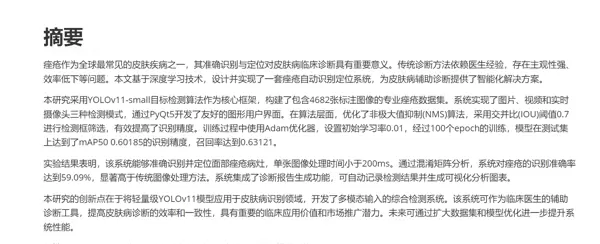

论文摘要

论文摘要

???? 项目分享:大家可自行获取用于参考学习,获取方式见文末!

???? 项目分享:大家可自行获取用于参考学习,获取方式见文末!

雷达卡

雷达卡

京公网安备 11010802022788号

京公网安备 11010802022788号