多变量时间序列预测中的三模态自适应融合方法

在金融、交通调度与能源管理等多个关键领域,多变量时间序列预测(Multivariate Time Series Forecasting)扮演着至关重要的角色。其核心目标是利用历史观测数据,准确推断未来的趋势变化。然而,由于实际数据中往往蕴含复杂的动态模式和跨维度关联,实现高精度预测仍面临巨大挑战。

当前主流方法,包括基于Transformer架构或大语言模型(Large Language Models)的方案,在处理此类任务时存在若干共性问题:部分模型仅聚焦于单一视角(如纯时间域或频域),忽略了多维度信息的互补性;另一些则采用静态的信息融合策略,难以根据不同预测长度灵活调整权重分配;此外,对异构数据类型(例如数值信号与文本描述)的有效整合能力普遍不足。

T3Time:一种三模态动态对齐与融合框架

为应对上述局限,本研究提出T3Time——一个支持时间、频率与文本三模态联合建模的预测框架。该方法通过创新性的自适应对齐机制,从三个不同表征空间提取特征,并根据上下文动态融合,从而生成更具判别力的综合表示。实验验证表明,T3Time在多个公开基准数据集上均显著优于现有最优模型,尤其在长期预测及小样本学习场景下展现出卓越性能。

一、论文基础信息

- 论文标题:T3Time: Tri-Modal Time Series Forecasting via Adaptive Multi-Head Alignment and Residual Fusion

- 作者:Abdul Monaf Chowdhury, Rabeya Akter, Safaeid Hossain Arib

- 所属机构:University of Dhaka

- 论文链接:https://arxiv.org/pdf/2508.04251v1

- 代码地址:https://github.com/monaf-chowdhury/T3Time/

二、主要贡献与技术创新点

- 设计了一个新颖的三模态预测架构,引入自适应多头交叉模态对齐机制,能够动态协调时间、频域与语义信息之间的关系。

- 提出预测时长感知的门控模块与通道级残差融合结构,增强了模型对不同时域跨度的适应能力,并提升了细粒度特征的表达效果。

- 在多种标准测试集上达到SOTA(state-of-the-art)水平,特别是在数据量有限的情况下仍保持出色的泛化能力。

三、模型结构与工作原理

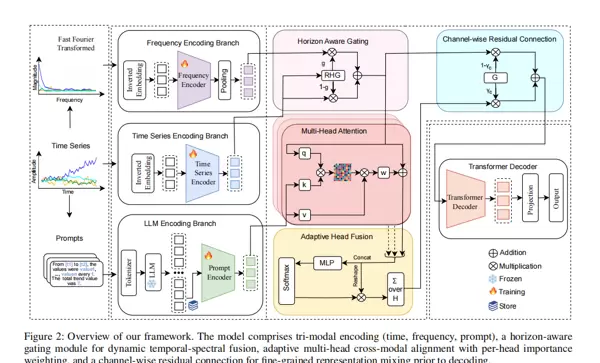

T3Time的核心思想在于:将原始时间序列分别映射到时间、频率与文本三种模态空间进行独立编码,再通过可学习的动态融合机制整合多源特征,最终输出统一的预测结果。

整体架构由三大阶段构成:三模态编码、自适应多头交叉模态对齐以及通道级残差连接。以下将逐层解析各组件功能。

1. 三模态编码(Tri-Modal Encoding)

模型设置三个并行分支,分别负责捕捉不同类型的信息特征。

(1)频率编码分支(Frequency Encoding Branch)

为了挖掘时间序列中潜在的周期性规律,该分支首先使用实值快速傅里叶变换(Fourier transform)将原始时序信号 $X_t \in \mathbb{R}^{B \times N \times L}$ 转换至频域,得到复数形式的频谱表示 $\hat{X}_t \in \mathbb{C}^{B \times N \times L_f}$,其中 $L_f = \lfloor L/2 \rfloor + 1$。

数学表达如下:

$$ \hat{X}_t = \mathcal{F}_r(X_t) \in \mathbb{C}^{B \times N \times L_f}, \quad L_f = \lfloor L/2 \rfloor + 1 $$随后提取幅度谱 $F$ 作为“频率令牌”,经过线性投影和Transformer编码器处理后,借助可训练的注意力机制进行加权池化,输出紧凑的频域特征 $\tilde{F} \in \mathbb{R}^{B \times N \times C}$。这一过程使模型能自动识别对当前预测任务最具影响力的频率成分。

(2)时间序列编码分支(Time Series Encoding Branch)

此分支专注于捕获时间维度上的动态演化特性。输入数据 $X_t$ 首先经共享线性层 $W_t$ 映射,将长度为 $L$ 的序列片段直接转换为 $C$ 维向量:

$$ Z_t = X_t W_t \in \mathbb{R}^{B \times N \times C} $$该操作保留了原始时序的局部与全局依赖关系,为后续跨模态交互提供基础表征。

(3)文本模态编码(Textual Modality Encoding)

对于伴随的时间序列文本描述(如事件日志、系统注释等),模型采用预训练语言模型(如BERT)进行编码,生成语义嵌入 $Z_{text}$。该部分补充了非数值型先验知识,提升模型对异常事件或外部干扰的理解能力。

2. 自适应多头交叉模态对齐

在获得三个模态的初始表示后,模型引入多头注意力机制实现跨模态信息对齐。每个注意力头独立学习不同子空间中的关联模式,并通过门控机制根据预测步长调节融合强度,确保短期与长期预测均能得到最优配置。

3. 通道级残差融合与预测解码

最后阶段采用通道维度的残差连接结构,将对齐后的多模态特征进行逐通道加权融合,增强梯度传播效率并防止信息丢失。融合后的表示送入解码器生成最终预测结果。

该操作将每个变量的时间窗口作为一个完整的单元进行嵌入处理,随后将这些嵌入输入到另一个Transformer编码器中,用以建模不同变量(channels)之间的时序依赖关系,最终生成具备上下文感知能力的时间特征表示 Zt ∈ B×N×C。

LLM编码分支(语言模型编码路径)

为了融合外部先验知识与语义信息,模型引入了一个预训练且参数冻结的GPT-2模块。该分支首先将各变量的时间序列切片转化为自然语言形式的提示(prompt)。例如,一条提示可能如下:“从[开始时间]到[结束时间],数值以[15分钟]为间隔依次为[数值1, …, 数值n],整体趋势值为[T]。” 这类文本描述随后被送入GPT-2进行编码,提取出对应的语义嵌入表示 ZLLM ∈ B×N×dLLM。这一过程显著增强了输入的信息维度,使模型不仅能捕捉数值变化模式,还能理解其背后的语义含义。

预测期感知门控模块

针对不同预测长度的任务,模型对时间局部特征和频率周期特征的需求存在差异:短期预测更关注近期动态,而长期预测则依赖于全局周期规律。为此,模型设计了一个门控机制来动态调节二者权重。该模块将预测长度与全局时间摘要拼接后,通过一个轻量级多层感知机(MLP)生成门控信号 g ∈ B×C。融合后的特征 Zg 按照以下公式计算:

Zg = g ⊙ F + (1g) ⊙ Zt ∈ B×C×N

其中 ⊙ 表示逐元素相乘。该门控系数 g 充当自适应开关,依据任务需求和输入特性,自动调整模型对频率特征与时间特征的关注比例。

自适应动态多头交叉模态对齐

这是模型的核心创新模块,旨在深度整合来自时频混合分支的特征 Zg 与来自LLM的语义特征 ZLLM。该结构扩展了传统的交叉模态对齐机制,采用多头注意力架构,以 Zg 作为查询(Query),ZLLM 作为键(Key)和值(Value),并通过多个独立的交叉注意力头计算对齐结果。

不同于传统多头注意力的简单拼接方式,本模块引入了自适应头融合策略。所有注意力头的输出 H(h) 首先被拼接,再由一个专用门控网络为每个样本中的每个变量分配各头的重要性权重 πb,n(h),计算方式如下:

πb,n(h) = exp(eb,n(h)) / Σj=1H exp(eb,n(j))

最终的对齐表示 Λ 是各头输出的加权和:

Λb,:,n = Σh=1H πb,n(h) Hb,:,n(h) ∈ C

这种机制赋予模型高度灵活性,使其能够根据每个变量的具体情况,动态选择最相关的语义视角(即注意力头),从而生成更具判别性的融合表征。

通道级残差连接与解码器

在进入解码阶段前,模型进一步优化特征表达。通过引入可学习的通道权重 γc,实现交叉模态对齐输出 Λ 与原始时频融合特征 Zg 的残差融合:

Θb,c,n = γc ⊙ Λb,c,n + (1γc) ⊙ Zg,b,c,n

该结构保留了原始特征的完整性,同时叠加了语义增强信息,提升了模型的整体表达能力和鲁棒性。

在模型设计中,以下公式用于实现多模态信息的融合:

\[ \Theta_{b,c,n} = \gamma_c \odot \Lambda_{b,c,n} + (1-\gamma_c) \odot Z_{g,b,c,n} \]

该操作确保在引入语义信息的同时,保留原始序列中的关键时频结构。最终得到的融合表示 $\Theta$ 被输入到标准的Transformer解码器中,并通过线性投影层生成预测输出 $\hat{Y}$。

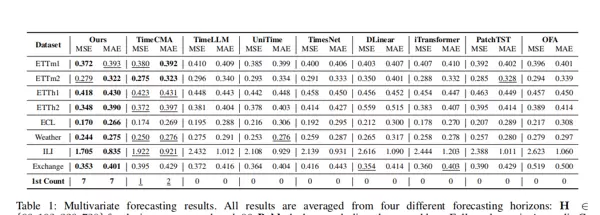

四、实验设计与结果分析

实验设置

为验证模型性能,研究在8个广泛使用的多变量时间序列数据集上进行了评估:ETTh1、ETTh2、ETTm1、ETTm2、ECL、Weather、ILI 和 Exchange。这些数据涵盖电力负荷、气象变化、金融市场以及医疗健康等多个实际领域。采用均方误差(MSE)和平均绝对误差(MAE)作为主要评价指标,数值越低代表性能越好。

对比实验(长期预测)

在标准的长期预测任务中,实验结果如表1所示,T3Time 在大多数数据集及不同预测长度下均取得了最优或接近最优的表现。相较于近期先进的基线模型(如 TimeCMA、TimeLLM 和 iTransformer),T3Time 在 MSE 指标上平均下降约 3.28%,在 MAE 上平均降低约 2.29%。这一结果充分体现了模型中三模态信息融合机制与自适应对齐策略的有效性,使其能够更精准地建模长时间依赖关系。

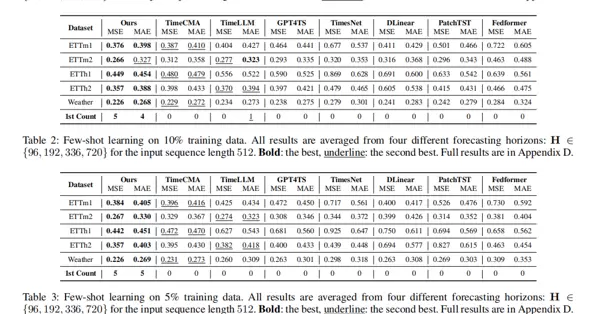

对比实验(小样本预测)

为进一步检验模型在有限数据下的泛化能力,研究设置了仅使用 10% 和 5% 训练样本的小样本学习场景。从表2和表3的结果可见,即便在极端稀疏的数据条件下,T3Time 仍显著优于其他对比方法。例如,在仅使用 5% 数据的情况下,其 MSE 和 MAE 分别比次优模型平均降低了 4.13% 和 1.91%。这表明,借助大语言模型提供的语义先验知识,T3Time 能有效缓解因训练数据不足带来的性能退化问题,具备出色的少样本学习能力。

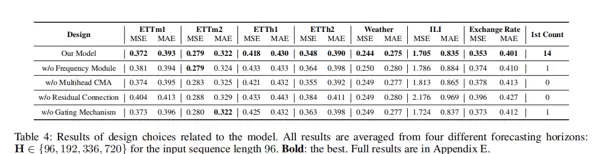

消融实验(设计变体分析)

为了验证各模块对整体性能的贡献,研究开展了一系列消融实验,结果汇总于表4:

- 移除频率模块 (w/o Frequency Module):性能明显下滑,说明周期性特征对于准确预测具有重要作用。

- 移除多头交叉模态对齐 (w/o Multihead CMA):性能下降,证明了跨模态信息需通过多角度、可学习的方式进行动态整合。

- 移除残差连接 (w/o Residual Connection):导致最严重的性能退步,平均 MSE 上升达 8.36%,表明保持原始时频通道信息对于维持表征完整性至关重要。

- 移除门控机制 (w/o Gating Mechanism):同样造成性能损失,说明根据预测阶段动态调节特征权重的策略是有效的。

上述分析表明,T3Time 中每个组件都经过精心设计,并在整体性能提升中发挥着不可替代的作用。

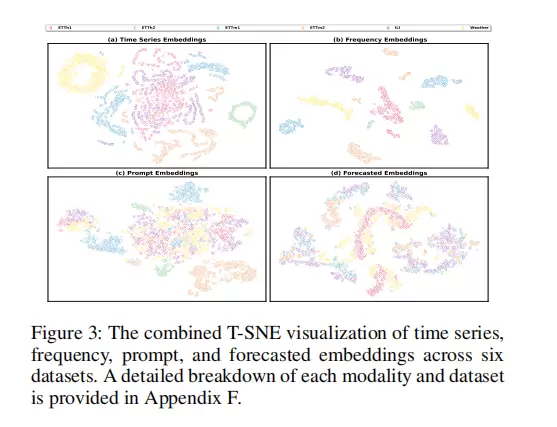

可视化对比

为进一步理解模型内部表示的变化过程,研究采用 t-SNE 对不同阶段生成的嵌入向量进行降维可视化,结果如图3所示:

初始的时间域和频率域嵌入(图3a, 3b)分布较为分散;而由 LLM 编码生成的提示嵌入(图3c)呈现出明显的簇状结构,反映出语义信息具备较强的类别区分能力。最重要的是,最终的预测嵌入(图3d)展现出更加紧凑和平滑的聚类形态,且结构上与时间嵌入相似但更为清晰。这直观地说明 T3Time 成功实现了多模态信息的深度融合,构建出一个高质量、结构化的特征空间。

五、论文结论与评价

总结

T3Time 提出了一种新颖的三模态融合框架,将时间、频率与语义信息统一建模。通过引入预测期感知的门控机制、自适应多头交叉模态对齐以及通道级残差连接,实现了对多源异构信息的动态高效整合。实验表明,该模型不仅在常规长期预测任务中超越现有先进方法,还在小样本场景下展现出卓越的鲁棒性和泛化能力。本研究为时间序列预测开辟了新的技术路径——即利用大语言模型的语义理解能力,结合传统时频分析手段,构建更具表现力的预测系统。

优点

- 创新的三模态视角:不同于多数仅聚焦于时域或频域的方法,T3Time 首次将 LLM 编码的语义模态纳入建模范畴,显著增强了数据表示的丰富性与深度。

- 高度的自适应性:模型中的多个关键组件(如门控系数、注意力融合权重、残差路径控制)均为可学习参数,可根据输入内容和任务需求动态调整融合策略,避免固定规则带来的局限性。

- 强大的小样本能力:得益于预训练语言模型蕴含的丰富世界知识,T3Time 在标注数据稀缺的情况下依然能学习到有效的特征模式,适用于现实世界中数据获取困难的应用场景。

缺点

- 模型复杂度与计算成本较高:由于集成了三个独立编码分支(含一个大语言模型)及多个复杂的注意力结构,T3Time 的训练与推理开销显著高于传统模型,对计算资源要求较高。

- 提示工程的依赖性:模型性能在一定程度上受提示模板设计的影响,如何自动化构造高效提示仍是需要进一步探索的问题。

模型的表现在很大程度上受到将时间序列转换为自然语言提示质量的影响。虽然研究中使用了固定的模板结构,但针对不同数据集特点设计更优且具备适应性的提示策略,依然是一个值得深入研究的方向。

自适应多头对齐机制尽管表现出较强的对齐能力,但其本质仍依赖于注意力机制中的“软”对齐方式。对于模态间关联极为紧密或极其微弱的特征,该方法可能存在对齐不充分或过度对齐的问题。因此,未来的研究可考虑引入更加显式的对齐约束机制,以提升跨模态表征的准确性与稳定性。

雷达卡

雷达卡

京公网安备 11010802022788号

京公网安备 11010802022788号