在人工智能(AI)的广阔领域中,机器学习(ML)作为核心技术之一,衍生出多个相互关联但各有专注方向的子领域。这些子领域不仅常被并列探讨,还经常在实际应用中融合使用。以下将对这些常见的“XX学习”类专业术语进行系统性梳理,厘清它们之间的联系与差异。

1. 机器学习(Machine Learning, ML)

机器学习是让计算机系统通过数据自动改进性能的技术总称。它是实现人工智能的主要路径之一,核心思想是从数据中学习规律,并用于预测或决策。传统上分为监督学习、无监督学习和强化学习三大范式。

定位:总纲性概念,深度学习和强化学习都属于它的子集。

定义:让计算机从数据中自动学习规律,而无需显式编程。

三大经典范式:

监督学习(Supervised Learning)

→ 有输入-输出对(标签),如分类、回归。

例子:垃圾邮件识别、房价预测

无监督学习(Unsupervised Learning)

→ 只有输入,无标签,目标是发现结构。

例子:聚类(K-means)、降维(PCA)、异常检测

强化学习(Reinforcement Learning)

→ 通过奖励信号学习策略(如前所述)

? 深度学习 ≈ 使用深度神经网络的机器学习方法,可应用于监督、无监督、强化等场景。2. 表示学习(Representation Learning)

表示学习关注如何自动发现数据的有效特征表达。相比于手工设计特征,该方法通过模型从原始输入中提取高层次、抽象化的表示,从而提升后续任务的性能。深度神经网络本质上就是一种强大的表示学习工具。

核心思想:自动学习数据的有效特征表示(而不是人工设计特征)。

与深度学习关系:深度学习本质上是一种强大的表示学习方法(如 CNN 自动学图像特征)。

例子:自编码器(Autoencoder)、Word2Vec、对比学习(Contrastive Learning)3. 迁移学习(Transfer Learning)

迁移学习旨在将在一个任务或领域中学到的知识迁移到另一个相关但不同的任务或领域中。这种方法特别适用于目标领域数据稀缺的情况,能够显著减少训练成本并提升模型泛化能力。

目标:将在一个任务上学到的知识迁移到另一个相关任务上。

典型用法:用 ImageNet 预训练的 ResNet 微调做医学图像分类。

与深度学习结合紧密,是现代 DL 实践的标准流程之一。4. 元学习(Meta-Learning / “Learning to Learn”)

元学习的目标是让模型具备快速适应新任务的能力。它通过在多个任务上进行训练,学习到一种通用的学习机制,使得面对全新任务时只需少量样本即可高效学习。这一方向在少样本学习(few-shot learning)中尤为关键。

目标:让模型学会如何快速适应新任务(通常只需少量样本)。

应用场景:小样本学习(Few-shot Learning)

例子:MAML(Model-Agnostic Meta-Learning)5. 自监督学习(Self-Supervised Learning)

自监督学习利用数据本身的结构生成监督信号,从而避免大量人工标注。例如,在语言模型中通过遮蔽部分词语来预测上下文。它是当前通向大规模无监督表征学习的重要路径,广泛应用于图像、语音和自然语言处理中。

特点:无标签,但通过设计“预文本任务”(pretext task)自动生成监督信号。

优势:可利用海量无标注数据(如所有网页文本、视频)。

代表工作:BERT(掩码语言建模)、SimCLR(图像对比学习)

地位:被视为通向通用人工智能的重要路径之一。6. 在线学习(Online Learning)

在线学习指模型在接收数据流的过程中持续更新自身参数,每接收到一个新样本就进行一次学习迭代。这种模式适用于动态环境和实时系统,强调低延迟和高适应性,常见于推荐系统和金融预测等场景。

特点:数据逐条到达,模型实时更新(而非批量训练)。

对比:传统 ML 是“离线/批量学习”。

应用:广告点击率预测、金融风控7. 因果推断(Causal Inference)

因果推断致力于识别变量间的因果关系,而非仅仅是相关性。它帮助模型理解“干预”带来的影响,对于医疗诊断、政策评估等领域至关重要。近年来,其与机器学习的结合成为提升模型可解释性和鲁棒性的研究热点。

目标:不只是找相关性,而是推断因果关系(A 是否导致 B?)

与 ML 区别:传统 ML 关注预测,因果推断关注干预效果(如“吃药是否真的治病?”)

新兴方向:因果机器学习(Causal ML)8. 生成模型(Generative Models)

生成模型用于学习数据的分布,进而生成新的、类似真实数据的样本。典型代表包括变分自编码器(VAE)、生成对抗网络(GAN)以及扩散模型(Diffusion Models)。这类模型在图像生成、文本合成和数据增强等方面有广泛应用。

目标:学习数据分布,生成新样本。

方法包括:

GAN(生成对抗网络)

VAE(变分自编码器)

扩散模型(Diffusion Models)

自回归模型(如 PixelRNN、GPT)

注意:生成模型可以基于深度学习,也可不用(如高斯混合模型)。各领域的结构关系图(简化版)

- 人工智能 (AI)

- 机器学习 (ML)

- 监督学习

- 深度学习(CNN, Transformer...)

- 无监督学习

- 聚类

- 降维

- 自监督学习 / 表示学习

- 强化学习

- 深度强化学习(DQN, PPO...)

- 迁移学习

- 元学习

- 在线学习

- 监督学习

- 机器学习 (ML)

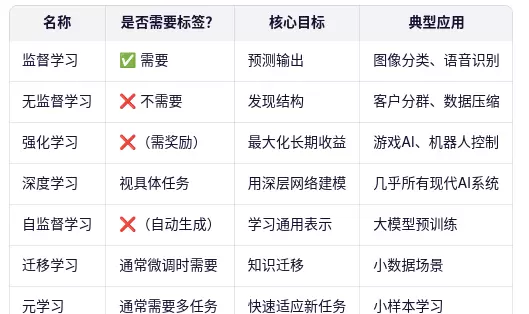

总结:常见“XX学习”术语速查表

当涉及机器人轨迹规划、动力学仿真或控制策略优化等任务时,你可能会接触到一些更具体的强化学习变体。

模仿学习(Imitation Learning):从专家示范中学习(介于监督学习和强化学习之间)

逆强化学习(Inverse RL):从行为反推奖励函数

雷达卡

雷达卡

京公网安备 11010802022788号

京公网安备 11010802022788号