最小二乘法的基本原理与求解过程

在信号处理和系统辨识等领域,最小二乘法(Least Squares, LS)是一种广泛使用的参数估计方法。其核心思想是通过最小化模型预测输出 Ax 与实际观测值 y 之间的误差平方和,来估计未知向量 x。该方法适用于线性模型的求解,尤其在存在噪声干扰的情况下具有良好的应用价值。

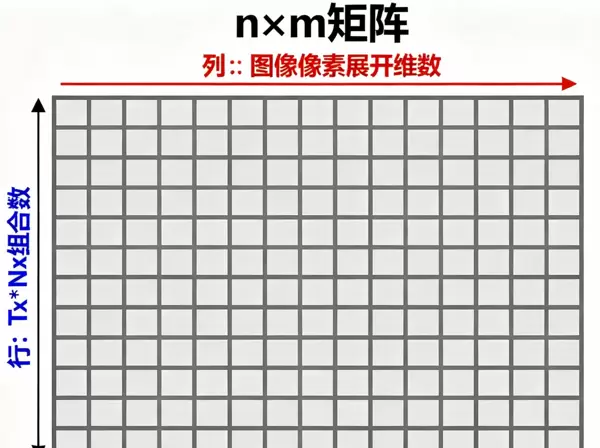

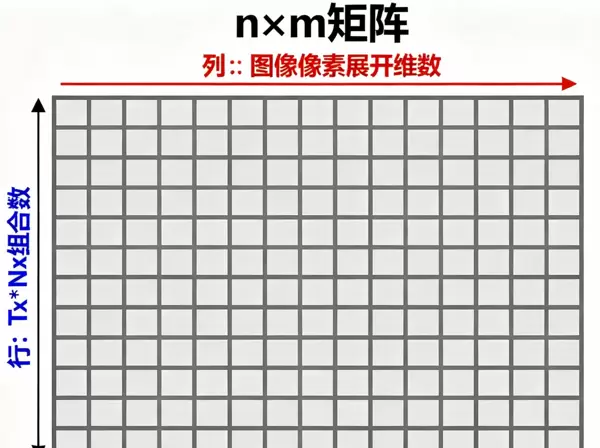

为便于理解,考虑一个典型的通信场景:原始信号 x(例如一幅图像,被离散化为400维向量)经过信道传输,受到测量矩阵 A 的作用,并叠加噪声 n,最终接收到的信号为:

y = Ax + n

其中:

- x ∈ m 表示待恢复的原始信号,可视为图像在 m 个像素点上的强度值;

- A ∈ n×m 是测量矩阵,元素 A[i,j] 表示第 i 次观测对第 j 个像素的响应权重;

- y ∈ n 是实际接收到的含噪观测数据;

- n ∈ n 代表加性噪声。

目标是从观测 y 中尽可能准确地重构出原始信号 x,即寻找一个 x,使得 Ax 尽可能接近 y。这一问题可形式化为以下优化问题:

minx ||Ax – y||

LS 算法的求解步骤

1. 构建最小化目标函数

最小二乘法的目标是最小化残差的平方和。定义代价函数如下:

J(x) = ||Ax – y||

将其转化为内积形式,便于后续数学处理:

J(x) = (Ax – y)(Ax – y)

2. 展开为目标函数的标准二次型

将上述表达式展开:

J(x) = (Ax)(Ax) – 2yAx + yy

= xAAx – 2xAy + yy

注意:yy 是与 x 无关的常数项,在求导过程中可以忽略。此外,虽然一般展开应包含两项 –yAx 和 –xAy,但由于它们均为标量且互为转置,因此相等,可合并为 –2xAy。

3. 对 x 求导并令导数为零

为了找到极小值点,对 J(x) 关于 x 求梯度:

xJ(x) = 2AAx – 2Ay

令梯度等于零:

2AAx – 2Ay = 0

简化得:

AAx = Ay

4. 解出最优解 x

若矩阵 AA 可逆,则可解得闭式解:

x = (AA)–1Ay

此即最小二乘估计的经典解析解,也称为正规方程(Normal Equation)解。

最小二乘法的局限性

尽管最小二乘法具有形式简洁、易于实现的优点,但也存在若干明显缺陷:

- 对噪声敏感:当观测数据中包含较大噪声或异常值时,LS 方法缺乏鲁棒性,可能导致估计结果严重偏离真实值;

- 要求矩阵满秩:只有当 AA 可逆时才能得到唯一解,若 A 列不满秩或条件数过大,则解不稳定甚至无法计算;

- 无稀疏性约束:标准 LS 不引入任何先验信息,无法利用信号可能具有的稀疏结构,导致在压缩感知等场景下性能受限;

- 过拟合风险:在欠定系统(n < m)中,存在无穷多解,LS 虽然给出最小范数解,但可能过度拟合噪声。

因此,在实际应用中常需结合正则化方法(如岭回归、LASSO)或其他改进策略以提升稳定性和泛化能力。

考虑目标函数:

J(\mathbf{x}) = \mathbf{x}^\top A^\top A \mathbf{x} - 2\mathbf{x}^\top A^\top \mathbf{y} + \text{const.}

为了求解该函数的最小值,需对 \mathbf{x} 求导,并令导数为零。

利用矩阵求导的基本公式(其中 Q 为对称矩阵):

\dfrac{\partial}{\partial \mathbf{x}} (\mathbf{x}^\top Q \mathbf{x}) = 2Q\mathbf{x}

\dfrac{\partial}{\partial \mathbf{x}} (\mathbf{b}^\top \mathbf{x}) = \mathbf{b}

注意以下两点:

- 第一个公式成立的前提是 Q 为对称矩阵。若不满足对称性,则有:

\dfrac{\partial}{\partial \mathbf{x}} (\mathbf{x}^\top Q \mathbf{x}) = (Q + Q^\top)\mathbf{x}。

此结论可通过基础矩阵运算推导得出。 - 对于第二项中的 \mathbf{x}^\top A^\top \mathbf{y},其维度为 1 \times m \times m \times n \times n \times 1 = 1 \times 1,因此是一个标量。根据标量转置不变性,可得:

\mathbf{x}^\top A^\top \mathbf{y} = (\mathbf{x}^\top A^\top \mathbf{y})^\top = \mathbf{y}^\top A \mathbf{x}。

将系数 -2 代入后,对应线性项的梯度中,\mathbf{b} = -2A^\top \mathbf{y}。

在当前问题中,设定 Q = A^\top A(显然对称),\mathbf{b} = -2A^\top \mathbf{y},于是目标函数的梯度为:

\frac{\partial J}{\partial \mathbf{x}} = 2A^\top A\mathbf{x} - 2A^\top \mathbf{y}

令一阶导数为 0,得到极值点条件:

2A^\top A\mathbf{x} - 2A^\top \mathbf{y} = 0

两边同时除以 2,整理得:

A^\top A\mathbf{x} = A^\top \mathbf{y}

上述方程被称为“法方程”(normal equations)。

接下来求解 \mathbf{x}。

若 A^\top A 可逆,则说明矩阵 A 列满秩,这要求测量数 N \ge M(即行数 ≥ 列数),且各列线性无关。在此条件下,左乘逆矩阵可得:

\mathbf{x} = (A^\top A)^{-1} A^\top \mathbf{y}

即最小二乘解为:

\hat{\mathbf{x}}_{LS} = (A^\top A)^{-1} A^\top \mathbf{y}

需要明确的是,这里的 N \ge M 表示测量数量不少于未知参数数量。具体而言,在本模型中:

- 矩阵 A 的列数对应图像像素展开后的维度,即未知数个数 M;

- 行数对应 Tx×Rx 组合的数量,即测量数 N。

因此,只有当未知数不超过测量数时,A^\top A 才可能满秩并可逆。否则将无法直接求逆,此时解不存在唯一性。

在实际应用中,矩阵 A 是预先已知的。例如建模过程中会设定规则:“像素越靠近某 Tx–Rx 路径,其对应权重越大,反之越小”。虽然实际中权重分配可能更为复杂,但关键在于 A 是确定的,可用于计算。而观测向量 \mathbf{y} 来自实际测量,自然也是已知的。因此,通过简单的矩阵运算即可恢复原始信号估计。

不懂代码的杰瑞学长最小二乘法(LS)的局限性

首先,如前所述,仅当 A^\top A 可逆时,才能获得唯一的闭式解。但在某些情况下,N \ge M 的条件无法满足,导致系统欠定,此时 \mathbf{x} 无唯一解。即使使用伪逆求解:

x_{\text{LS}} = A^{\dagger} \mathbf{y},

所得结果往往缺乏明确的物理意义。

此外,LS 方法完全不依赖任何先验信息,仅是在高维空间中寻找一个使残差 A\mathbf{x} \approx \mathbf{y} 最小的估计解,本质上是一种纯数据驱动的优化策略,缺乏对结构或稀疏性等潜在特性的利用。

[此处为图片3]

在信号处理中,我们常常面对如下的线性近似关系:

A𝒙 ≈ 𝒚

其中,𝒙 表示原始信号。然而,真实的原始信号并非任意的 m 维向量,它通常具备一定的内在结构特性,例如:

- 空间相关性:相邻像素之间呈现连续或平滑的变化趋势;

- 稀疏性:信号中的高能量成分往往集中在少数区域;

- 局部性:物理场强变化不会出现剧烈跳跃;

- 物理约束:如信号衰减随传播距离增加而增强。

不懂代码的杰瑞学长相比之下,最小二乘(LS)估计方法则假设𝒙可以是任意形式的向量,完全不依赖于上述物理先验信息。该方法不对信号施加平滑性、稀疏性或连续性等约束,其结果仅由观测数据本身决定。

本文旨在帮助读者建立对 LS 算法的基本理解。尽管推导公式过程较为繁琐,但通过逐步分析,能够更清晰地把握其原理与局限。

雷达卡

雷达卡

京公网安备 11010802022788号

京公网安备 11010802022788号