Transformer:现代 AI 的“最强大脑” —— 小白也能看懂的超通俗解读

1. 引言:ChatGPT 背后的核心技术

如今,ChatGPT 已经成为许多人日常使用的智能助手,它能写诗、编程、回答问题,甚至陪你聊天。但你是否好奇,它的“智慧”从何而来? 其实答案就藏在 GPT 这个名字中—— T 指的就是 **Transformer**。 这个名字虽然让人联想到变形金刚,但它真正的威力在于彻底改变了人工智能处理语言的方式。在 Transformer 出现之前,AI 理解文本的能力非常有限,就像刚识字的孩子,前读后忘;而 Transformer 的诞生,让机器具备了“通读全文、融会贯通”的能力。 接下来,我们将用最简单的语言,不涉及任何数学公式,带你一步步揭开这个驱动现代 AI 的核心引擎的神秘面纱。2. 旧时代模型的局限性:RNN 遇到的瓶颈

在 Transformer 问世前,主流的语言处理模型是 **RNN(循环神经网络)**。 它的运作方式类似于人类逐字阅读的过程: - 必须先理解第一个词,再结合第二个词继续推进; - 像一条流水线,一个接一个地处理信息。 这种方式带来了两个致命缺陷: 处理速度慢:无法并行计算,必须按顺序一步步来,效率极低。 记忆能力弱:当句子过长时,开头的信息很容易被遗忘,导致上下文断裂。 举个例子: 想象一位翻译官听你讲述一段长达数分钟的发言。当他听到最后一句时,早已忘记了你最初提到的主语是谁,结果翻译出的内容驴唇不对马嘴。 这就是 RNN 在面对复杂语言任务时的真实写照。3. 突破性创新:注意力机制登场

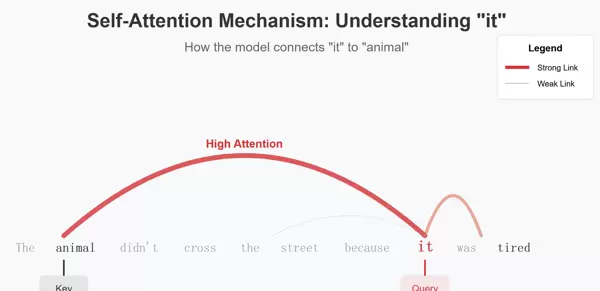

2017 年,Google 团队发表了一篇划时代的论文《Attention is All You Need》,正式推出了 **Transformer** 架构。其核心突破在于引入了 **Self-Attention(自注意力机制)**。 这项技术的最大优势是: AI 不再需要逐字扫描,而是可以**一次性读取整段文本**,并在内部自动判断哪些词语之间存在关联。 比如看到这句话:“苹果不仅好吃,也是一家伟大的公司。” 传统模型可能会困惑:“苹果”是指水果还是品牌? 而 Transformer 会同时分析“好吃”和“公司”这两个关键词。 如果它发现“公司”权重更高,就能立刻判断这是指科技企业;反之则指向水果。 这种“在理解某个词时,动态参考整个句子其他部分”的能力,正是注意力机制的精髓所在。 ![注意力机制原理图]

图解:当模型读到 “it”(它)时,注意力机制会告诉它,这里的 “it” 指的是 “animal”(动物),而不是 “street”(街道),因为后文出现了 “tired”(累了)这一线索。

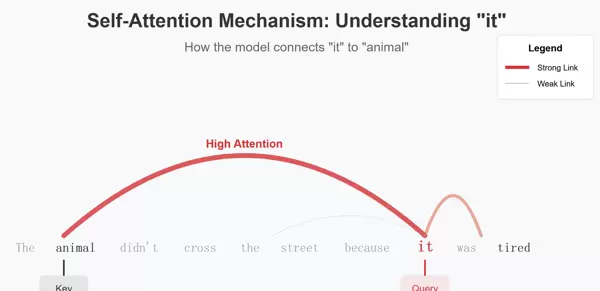

![注意力机制原理图]

图解:当模型读到 “it”(它)时,注意力机制会告诉它,这里的 “it” 指的是 “animal”(动物),而不是 “street”(街道),因为后文出现了 “tired”(累了)这一线索。

4. 核心结构解析:编码器与解码器的协作

Transformer 的整体架构由两个主要模块构成,它们像一对默契的搭档共同完成语言任务: 1. 编码器(Encoder)—— 深度理解输入内容 它的职责是将原始文本(如中文句子)转化为计算机可处理的向量表示。 相当于一位经验丰富的阅读专家,能够深入挖掘语义内涵,提炼出关键信息。 2. 解码器(Decoder)—— 生成目标输出 它根据编码器提供的语义信息,逐步生成新的文本,比如英文翻译或自然流畅的回答。 就像一位才思敏捷的作家,能依据已有思路不断产出高质量内容。 不同的模型侧重不同组件: - BERT 主要使用编码器,在问答、文本分类等理解类任务上表现卓越。 - GPT 则专注于解码器,擅长文本生成,也是 ChatGPT 的技术基础。5. 解决顺序难题:位置编码的作用

既然 Transformer 可以“一眼看完所有词”,那它如何知道词语之间的先后顺序呢? 毕竟,“我爱你”和“你爱我”虽然字相同,含义却完全相反。 为解决这个问题,系统引入了 **Positional Encoding(位置编码)**。 这就好比老师在教室里给每位学生分配座位号: 虽然老师能同时看到全班同学(即所有单词),但每个人身上都贴着唯一的编号(如1号、2号……)。这样,AI 既能并行处理所有词汇,又能准确掌握它们的排列顺序,避免语义混乱。6. Transformer 带来的变革

自从 Transformer 登场,人工智能的发展进入了快车道: 运算效率大幅提升:支持并行计算,训练速度远超以往模型。 语义理解更加精准:能捕捉长距离依赖关系,写出逻辑严密的文章与代码。 应用范围广泛扩展:不仅限于文本处理,后来还衍生出 Vision Transformer(用于图像识别)、视频生成模型 Sora 等,展现出强大的通用性。7. 总结:一场语言智能的革命

如果把 AI 的发展历程比作工业革命,那么 Transformer 就如同当年的蒸汽机,开启了全新的时代。 它彻底抛弃了“逐字推进”的老旧模式,通过“注意力机制”赋予机器前所未有的上下文感知能力。从此,AI 第一次真正意义上学会了在复杂语境中把握语言的核心意义。 正是这一架构,奠定了今天几乎所有大型语言模型的技术根基,成为现代人工智能当之无愧的“最强大脑”。当你再次对 ChatGPT 回答的精准程度感到惊叹时,不妨想一想:在那个简洁的对话框背后,其实隐藏着一个名为 Transformer 的强大模型。

它依靠成千上万个“注意力头”,在浩瀚如海的数据中高速运转,不断捕捉和理解你输入文字中的深层含义。正是这种复杂的机制,让它能够尽可能贴近你的意图,读懂你真正想表达的内容。

雷达卡

雷达卡

京公网安备 11010802022788号

京公网安备 11010802022788号